网络知识学习方法与技巧

网络知识学习方法与技巧

一、学习路径:从理论到实战

1. 系统化学习框架

plantegg 博客提供了三大核心系列,构建完整的网络知识体系:

- Understanding TCP 系列 - TCP 协议全方位解析

- Understanding Network 系列 - 网络基础概念深入

- Understanding Load Balancing 系列 - 负载均衡策略与实践

学习建议:不要孤立学习理论,而是将理论与生产案例结合。plantegg 的内容强调从实际问题出发,通过案例理解原理。

2. 问题驱动的学习方法

plantegg 博客的核心特点是问题导向:

- 从生产环境的真实故障入手

- 通过排查过程学习工具使用

- 在解决问题中理解底层原理

- 积累可复用的诊断方法论

实践路径:

- 遇到问题 → 2. 抓包分析 → 3. 定位根因 → 4. 理解原理 → 5. 总结方法

二、核心知识领域

1. TCP 连接管理

连接队列监控

理解 TCP 连接的两个关键队列:

- SYN 队列(半连接队列):存储 SYN_RECV 状态的连接

- Accept 队列(全连接队列):存储 ESTABLISHED 但未被 accept() 的连接

实时监控工具:

1 | # 使用 bpftrace 工具包中的 tcpaccept |

输出示例解读:

- PID/COMM:接受连接的进程信息

- RADDR/RPORT:远程地址和端口

- LADDR/LPORT:本地地址和端口

- Accept Queue:当前队列大小/最大队列大小

关键洞察:

- 队列满时会导致连接被丢弃(SYN 丢弃或 ACK 丢弃)

- 通过监控队列状态可以提前发现性能瓶颈

- 队列大小受

somaxconn和应用层backlog参数影响

Socket 选项优化

SO_REUSEPORT - 多进程负载均衡:

1 | int listenfd; |

核心价值:

- 允许多个进程绑定同一 IP:Port

- 内核通过哈希分发连接,实现负载均衡

- 解决”惊群效应”(thundering herd)

- 提升多核 CPU 利用率

适用场景:

- Nginx 多 worker 进程同时监听

- 高并发服务器提升连接接收能力

- 避免单一监听 socket 成为瓶颈

SO_REUSEADDR vs SO_REUSEPORT:

SO_REUSEADDR:允许 TIME_WAIT 状态下快速重启服务SO_REUSEPORT:多进程负载均衡,性能优化

2. Buffer 与内存管理

Socket 内存信息解读

使用 ss -m 查看 socket 内存状态:

1 | ss -m |

输出字段含义:

r:接收缓冲区已分配内存rb:接收缓冲区大小(sk_rcvbuf)t:发送缓冲区已分配内存tb:发送缓冲区大小(sk_sndbuf)f:forward allocation(预分配内存)w:发送队列中的数据o:选项内存(如 TCP options)bl:backlog 队列长度d:丢弃的包数量

内核实现(参考):

1 | void sk_get_meminfo(const struct sock *sk, u32 *mem) |

诊断技巧:

r接近rb:接收缓冲区快满,应用层消费慢t接近tb:发送缓冲区快满,网络发送慢或对端接收慢d持续增长:socket 丢包,需检查缓冲区大小和应用处理速度bl持续非零:backlog 队列有积压,应用 accept() 速度慢

内核参数调优

关键参数:

1 | # 查看网络软中断预算 |

常见调优参数:

net.core.netdev_budget:单次软中断处理的最大包数net.core.somaxconn:listen() 的最大 backlognet.ipv4.tcp_rmem:TCP 接收缓冲区(min/default/max)net.ipv4.tcp_wmem:TCP 发送缓冲区(min/default/max)net.ipv4.tcp_max_syn_backlog:SYN 队列最大长度

调优原则:

- 先监控,后调优(避免盲目调整)

- 理解参数含义和影响范围

- 在测试环境验证效果

- 记录调优前后的性能指标

3. TCP 性能指标

关键性能指标

RTT(Round-Trip Time):

- 衡量网络延迟的核心指标

- 影响 TCP 吞吐量:

Throughput ≈ Window Size / RTT - 通过

tcp.analysis.ack_rtt字段分析

重传率:

- 反映网络质量和拥塞情况

- 类型:超时重传、快速重传

- 高重传率可能原因:网络丢包、接收端处理慢、拥塞

窗口大小:

- 接收窗口(rwnd):接收端通告的可用缓冲区

- 拥塞窗口(cwnd):发送端的拥塞控制窗口

- 实际窗口 = min(rwnd, cwnd)

丢包与重传分析:

tcp.analysis.retransmission:重传包tcp.analysis.fast_retransmission:快速重传tcp.analysis.duplicate_ack:重复 ACKtcp.analysis.lost_segment:丢失的段

TCP 选项优化

TCP_CORK:

1 | 当设置 TCP_CORK 时,会将非满帧排队,直到清除该选项。 |

应用场景:

- 减少小包发送,提升网络效率

- 适合批量数据传输

- 与

sendfile()配合使用

4. 负载均衡与高可用

SO_REUSEPORT 实现负载均衡

工作原理:

- 内核通过哈希算法分发连接到不同进程

- 每个进程独立 listen() 和 accept()

- 避免进程间锁竞争

性能提升:

- 多核 CPU 并行处理连接

- 消除单一监听 socket 瓶颈

- 提升高并发场景下的吞吐量

Nginx 配置示例:

1 | worker_processes 4; |

优化要点:

accept_mutex off:配合 SO_REUSEPORT 使用sendfile:零拷贝技术,减少 CPU 消耗tcp_nopush:与 TCP_CORK 类似,批量发送open_file_cache:缓存文件描述符,提升短连接性能

三、实战诊断方法论

1. 性能问题排查流程

第一步:确定问题现象

- 延迟高?吞吐量低?连接失败?

- 收集监控数据:CPU、内存、网络流量、连接数

第二步:抓包分析

- 使用 tcpdump 捕获流量

- 用 tshark/Wireshark 分析关键指标

第三步:定位瓶颈

- 网络层:RTT、丢包率、重传率

- 传输层:窗口大小、队列状态

- 应用层:响应时间、处理速度

第四步:验证假设

- 调整参数或代码

- 对比调整前后的性能数据

- 确认问题是否解决

2. 常见问题模式

模式 1:高延迟

可能原因:

- 网络 RTT 高(物理距离、路由跳数)

- 应用层处理慢(数据库查询、计算密集)

- 队列积压(accept 队列、backlog 队列)

诊断方法:

- 分析

tcp.analysis.ack_rtt确定网络延迟 - 分析应用层响应时间(如 MySQL query time)

- 检查队列状态(tcpaccept、ss -l)

模式 2:高重传率

可能原因:

- 网络丢包(链路质量差、拥塞)

- 接收端处理慢(窗口满、应用消费慢)

- 发送端突发流量(超过网络容量)

诊断方法:

- 统计重传类型(超时 vs 快速重传)

- 检查窗口大小变化

- 分析丢包位置(发送端、中间网络、接收端)

模式 3:连接失败

可能原因:

- SYN 队列满(半连接队列溢出)

- Accept 队列满(全连接队列溢出)

- 防火墙/安全组规则

- 端口耗尽

诊断方法:

- 检查

netstat -s | grep -i listen - 监控队列状态(tcpaccept)

- 检查可用端口范围

3. 分层诊断策略

应用层:

- 响应时间分布(P50/P95/P99)

- 慢查询分析

- 业务逻辑性能

传输层(TCP):

- 连接建立时间

- 数据传输效率

- 连接关闭状态(TIME_WAIT 数量)

网络层(IP):

- 路由路径

- MTU 设置

- 分片情况

链路层:

- 网卡队列

- 软中断分布

- 丢包统计

四、工具链与技能树

1. 必备工具

抓包与分析:

- tcpdump:流量捕获

- tshark:命令行分析

- Wireshark:图形化深度分析

连接监控:

- ss:socket 统计(替代 netstat)

- tcpaccept:连接队列监控(bpftrace)

- netstat:传统网络统计

性能分析:

- perf:CPU 性能分析

- sar:系统活动报告

- iftop:实时流量监控

内核调试:

- sysctl:内核参数查看/设置

- bpftrace/eBPF:内核动态追踪

- SystemTap:内核探测

2. 技能进阶路径

初级(理解基础):

- TCP 三次握手、四次挥手

- 常见状态(ESTABLISHED、TIME_WAIT、CLOSE_WAIT)

- 基本抓包和过滤

中级(诊断问题):

- 重传、丢包、窗口分析

- 内核参数调优

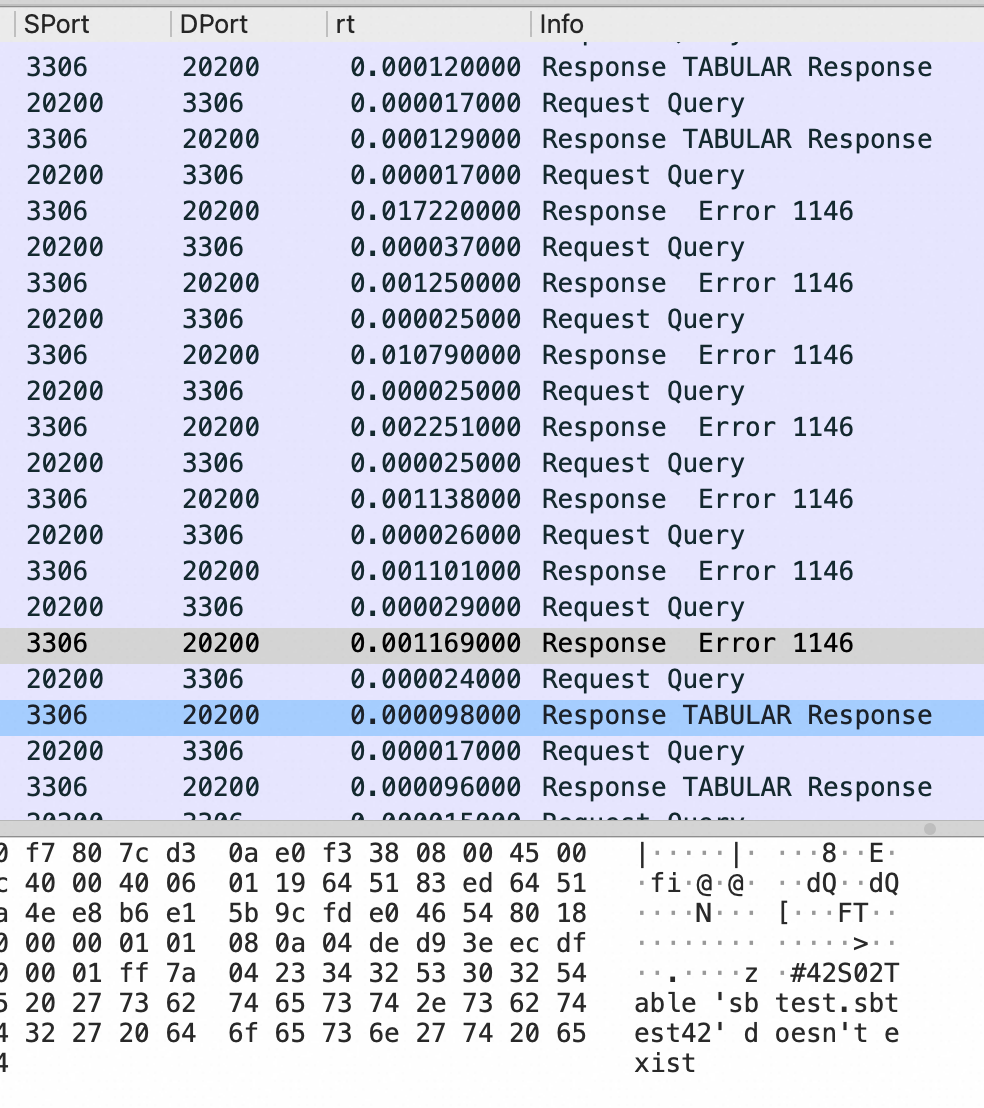

- 应用层协议解析(HTTP、MySQL)

高级(性能优化):

- 拥塞控制算法

- 零拷贝技术(sendfile、splice)

- 内核网络栈优化

- eBPF 自定义追踪

专家级(架构设计):

- 高性能网络架构设计

- 负载均衡策略

- 容错与降级方案

- 大规模分布式系统网络优化

五、学习资源与实践建议

1. plantegg 博客特色

理论与实践结合:

- 每个概念都有生产案例支撑

- 提供完整的命令和代码示例

- 强调可复现的实验方法

问题驱动:

- 从真实故障出发

- 展示完整的排查过程

- 总结可复用的方法论

工具导向:

- 详细的工具使用指南

- 参数含义和适用场景

- 输出结果的解读方法

2. 实践建议

搭建实验环境:

- 使用虚拟机或容器模拟网络场景

- 用 tc(traffic control)模拟延迟、丢包

- 搭建简单的客户端-服务器程序

动手实验:

- 复现博客中的案例

- 修改参数观察效果

- 记录实验结果和心得

建立知识库:

- 整理常用命令和参数

- 记录典型问题的排查步骤

- 积累自己的案例库

持续学习:

- 关注内核版本更新(新特性、新参数)

- 学习新工具(eBPF、XDP)

- 阅读内核源码(理解实现细节)

3. 避免的误区

误区 1:只学理论不实践

- 网络知识必须通过实验验证

- 理论与实际环境可能有差异

误区 2:盲目调优参数

- 先理解参数含义和影响

- 在测试环境验证效果

- 记录调优前后的对比数据

误区 3:忽视应用层

- 很多”网络问题”实际是应用层问题

- 要结合应用日志和业务逻辑分析

误区 4:过度依赖工具

- 工具是手段,理解原理才是目的

- 学会从工具输出推导底层行为

六、总结

plantegg 博客的核心价值在于:

- 系统化:完整的知识体系,从基础到高级

- 实战化:真实案例,可复现的实验

- 工具化:详细的工具使用指南

- 方法论:可复用的问题排查流程

学习网络知识的最佳路径:

- 理论学习 → 动手实验 → 问题排查 → 性能优化 → 架构设计

持续提升的关键:

- 保持好奇心,深入理解原理

- 多动手实践,积累经验

- 建立自己的知识体系和工具链

- 关注技术演进,学习新技术

文档生成时间:2026-01-18

来源:plantegg.github.io (Context7 库)

适用对象:系统工程师、SRE、后端开发、网络工程师